C’est sûrement une fin que les scénaristes de la série dystopiste Black Mirror n’auraient pas imaginée. Le conseil municipal de San Francisco aux États-Unis vient de voter une loi interdisant l’utilisation dans la rue d’algorithmes de reconnaissance faciale destinés à la protection des civils. Et pourtant, comment refuser une technologie qui peut par un mécanisme efficace et rapide détecter les bandits les plus recherchés du territoire, les suspects potentiels de crime grâce aux portraits robots, ou encore des personnes déclarées perdues ? La question a priori simple soulève au contraire des problématiques bien plus larges et bien plus complexes. Une chose est certaine, malgré les apparences, cette question n’est assurément pas qu’algorithmique, mais aussi et surtout sociétale et éthique !

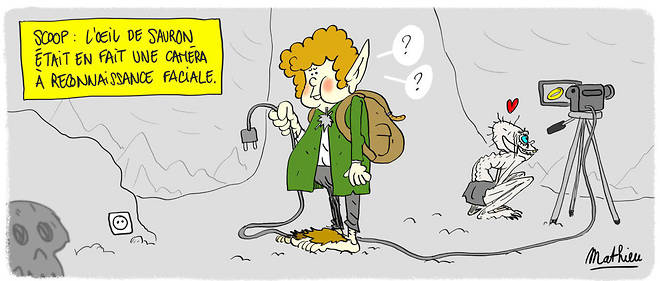

Les algorithmes de reconnaissance faciale sont apparus dans notre quotidien avec l’arrivée des derniers smartphones. Certains les utilisent à outrance, d’autres s’en méfient et enfin quelques-uns n’en voient pas l’utilité. Embarqués dans nos mobiles, leur utilisation reste un choix personnel (et espérons-le éclairé), mais leur présence envahissante dans la rue est une tout autre histoire. Il est temps de comprendre ces outils qui agitent les esprits, d’habitude les plus calmes, afin de mieux dessiner les contours de ce débat pour le faire avancer durablement.

Ces dispositifs présentent encore des défis techniques liés à la masse croissante d’informations récoltée et des temps d’exécution, mais qui seront assurément résolus dans le futur. Il existe également des préoccupations sur l’apparition de biais dans ces algorithmes, qui peuvent porter à des discriminations sur la couleur de peau, le genre ou encore la tenue vestimentaire. En effet, les algorithmes qui apprennent sur des données du passé, peuvent transformer une tendance statistique en un élément qui détermine le résultat. Quand on sait que près de 65 % des personnes actuellement en prison aux États-Unis sont hispaniques ou afro-américaines on est en droit de porter un œil critique sur l’utilisation des statistiques pour modéliser le futur. Le cas échéant, on risque d’assimiler fortement, voire systématiquement, la personne de type hispanique ou afro-américaine comme un sujet à risque.

Consentement systématique ?

La reconnaissance faciale par comparaison, dans le cas de recherche d’une personne précise (par un portrait-robot ou par une photo, par exemple), est plus prometteuse. Mais, là encore, doit-on accepter l’emploi intensif de ces algorithmes dans nos rues ? Face à la principale raison de protection policière invoquée par les défenseurs de cette technologie, s’oppose la protection des libertés individuelles. Certains défenseurs avancent même que cette technologie est déjà utilisée dans les zones de sécurité et d’identification des aéroports. Mais c’est écarter un point important : notre consentement systématique à chaque cas d’usage. Là où les algos de comparaison tourneront en continu dans la rue sans que nous le réalisions, dans les aéroports nous donnons notre accord en nous mettant face caméra pour valider notre identité.

Alors que la majorité des discussions tournent rapidement autour des capacités de ces algorithmes, nous entrons encore trop timidement dans le fond du sujet : la vie privée, les droits individuels, le principe de précaution et tant d’autres choses. Qu’on ne se trompe pas, discuter du fonctionnement de ces algorithmes est un point fondamental, mais c’est souvent la face émergée de l’iceberg !